Ein gut strukturiertes Rechenzentrumslayout ist die Grundlage für einen stabilen, kontinuierlichen Betrieb der IT-Infrastruktur. Unabhängig davon, ob Sie sich in einer frühen Planungsphase befinden oder eine bestehende Anlage betreiben, bestimmen zwei Fragen jedes Rechenzentrum:

- Was sind die Kernkomponenten eines Rechenzentrums?

- Welche physische Infrastruktur benötigt eine Rechenzentrumsanlage?

In diesem Leitfaden erklärt gbc engineers, wie ein typisches Rechenzentrumslayout aufgebaut ist, welchen Beitrag die einzelnen Zonen zu Leistung und Zuverlässigkeit leisten und welche Planungsprioritäten im Jahr 2026 Rechenzentrumsanlagen weltweit prägen.

Was ist ein Rechenzentrumslayout?

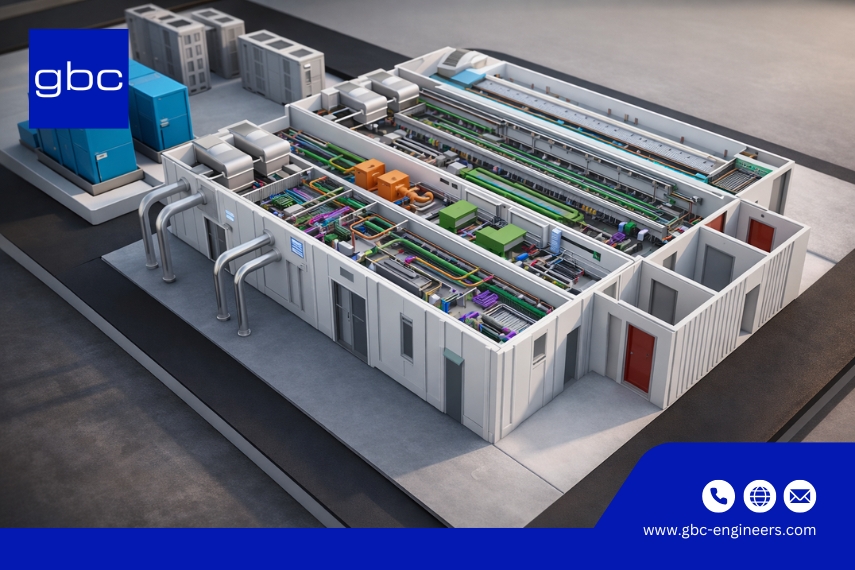

Ein Rechenzentrumslayout ist die geplante physische Anordnung von IT-Infrastruktur, Stromversorgungssystemen, Kühltechnik und Sicherheitskontrollen innerhalb einer Rechenzentrumsanlage. Ein gut geplantes Layout gewährleistet einen zuverlässigen 24/7-Betrieb, Energieeffizienz, physische Sicherheit und Skalierbarkeit für zukünftiges Wachstum.

Die drei wichtigsten Zonen eines Rechenzentrumslayouts

Ein Standardlayout für Rechenzentren ist in drei zentrale Funktionszonen gegliedert, die jeweils eine klar definierte und kritische Rolle übernehmen:

|

Zone

|

Hauptfunktion

|

Wichtige Ausrüstung

|

|

Serverraum

|

IT-Verarbeitung, Speicher, Netzwerk

|

Server, Switches, Router, Firewalls, Speicher-Arrays

|

|

Stromversorgungsraum

|

Stromversorgung, Aufbereitung, Backup

|

USV, Generatoren, PDUs, Schaltanlagen, Transformatoren

|

|

Network Operations Center (NOC)

|

24/7-Überwachung, Management, Incident Response

|

Videowände, DCIM, Alarmsysteme, Remote-Zugriffskontrollen

|

1. Serverraum (Computerraum)

Der Serverraum ist das operative Herzstück des Rechenzentrums und beherbergt alle kritischen IT-Geräte. Er ist ein klimatisierter, zugangsbeschränkter Bereich, der darauf ausgelegt ist, die Rechendichte zu maximieren und gleichzeitig optimale Betriebsbedingungen sicherzustellen.

Zur Standardausstattung eines Serverraums gehören:

- Server: Rack-montierte, Blade- oder modulare Rechenknoten für Verarbeitung und lokalen Speicher

- Top-of-Rack-(ToR)-Switches und Core-Router: Bereitstellung interner East-West- und externer North-South-Netzwerkkonnektivität

- Firewalls und Load Balancer: Für Perimetersicherheit, Verkehrssteuerung und Anwendungsbereitstellung

- Speichersysteme: SANs, NAS-Arrays und All-Flash-NVMe-Speicher für leistungsstarkes Datenmanagement

- Application Delivery Controller (ADCs): Optimierung von Anwendungsleistung und Verfügbarkeit

Moderne Serverräume arbeiten zunehmend mit hohen Dichten (10–30+ kW/Rack für Standard-Workloads; 40–100+ kW/Rack für KI-/GPU-Cluster). Dadurch steigt der Einsatz von Direct Liquid Cooling (DLC) und Immersionskühlung auf Rack-Ebene neben traditionellen luftbasierten Kühlsystemen.

ASHRAE TC 9.9 definiert empfohlene Betriebsbereiche für IT-Geräte. Geräte der Klasse A2 — die häufigste Klassifizierung für Unternehmensserver — sind für Zulufttemperaturen am Einlass von 10–35 °C (50–95 °F) ausgelegt, mit einem zulässigen Bereich von 5–40 °C (41–104 °F). Die meisten Anlagen zielen auf eine Zulufttemperatur von 18–27 °C (64–80 °F), um sichere Betriebsreserven einzuhalten.

2. Stromversorgungsraum

Der Stromversorgungsraum steuert alle Aspekte der Energieversorgung des Rechenzentrums — vom Netzanschluss bis zum einzelnen Rack. Sein Design bestimmt direkt die Zuverlässigkeit, Effizienz und Tier-Klassifizierung der Anlage.

Kernkomponenten des Stromversorgungsraums:

- Unterbrechungsfreie Stromversorgung (USV): Stellt bei Netzunterbrechungen übergangslos Überbrückungsleistung bereit, während Generatoren anlaufen. Die Doppelwandler-Topologie (online) gemäß IEC 62040-3 Klasse VFI ist Standard für Tier-III- und Tier-IV-Anlagen.

- Notstromgeneratoren: Diesel- oder Gasgeneratoren, die für die gesamte Anlagenlast ausgelegt sind, typischerweise mit Kraftstoffvorrat für 12–48 Stunden vor Ort. Automatische Netzumschalter (ATS) stellen die Umschaltung innerhalb von 10–30 Sekunden sicher.

- Mittelspannungsschaltanlagen und Transformatoren: Bei Anlagen über ca. 1 MW wandeln Mittelspannungsschaltanlagen (10–22 kV in Europa; 12–25 kV in Nordamerika) die Netzspannung über Trockentransformatoren herunter.

- Power Distribution Units (PDUs): Verteilereinheiten auf Flurebene, die die Leistung heruntertransformieren und an IT-Racks verteilen, einschließlich Überwachung der Abzweigstromkreise.

- Rack-PDUs (rPDUs): In IT-Racks montiert für die finale Stromverteilung, mit Messfunktion und bei verwalteten Varianten mit Remote-Schaltmöglichkeit.

Moderne Anlagen nutzen eine duale A+B-Stromversorgungsarchitektur, bei der jede kritische IT-Last über zwei vollständig unabhängige Strompfade versorgt wird. Dadurch wird jeder einzelne Ausfallpunkt in der Stromverteilungskette vermieden.

Power Usage Effectiveness (PUE) — das Verhältnis von Gesamtenergieverbrauch der Anlage zur Energieaufnahme der IT-Geräte — ist die wichtigste Kennzahl für Energieeffizienz. Zielwerte nach Anlagentyp:

|

Anlagentyp

|

Ziel-PUE (2026)

|

Quelle / Benchmark

|

|

Hyperscale (Google, Meta)

|

1.08–1.12

|

Google Environmental Report 2024; Meta Sustainability Report 2024

|

|

Enterprise Tier III

|

1.3–1.5

|

Uptime Institute Global DC Survey 2024

|

|

EU-Code-of-Conduct-konform

|

≤1,3 (neu) / ≤1,5 (bestehend)

|

EU DC Code of Conduct v14 (2024)

|

|

Colocation-Durchschnitt

|

1.45–1.58

|

Uptime Institute Global DC Survey 2024

|

3. Network Operations Center (NOC)

Das Network Operations Center ist die zentrale Leitstelle für die Überwachung und Steuerung der gesamten IT- und physischen Infrastruktur des Rechenzentrums. In modernen Anlagen integriert das NOC IT-Monitoring, physische Sicherheit, Umweltkontrollen und Energiemanagement in ein einheitliches Betriebsbild.

Zu den typischen NOC-Funktionen gehören:

- Videowände mit Echtzeitdarstellung von Netzwerktopologie, Serverzustand und Umgebungs-Dashboards

- Data Center Infrastructure Management (DCIM)-Software — die zentrale Übersicht für Kapazitätsplanung, Asset Management und Energieoptimierung

- Integration von Security Information and Event Management (SIEM) für die Cybersicherheitsüberwachung

- Physische Sicherheitssysteme: CCTV, Zutrittskontrolle (Biometrie + Kartenleser), Mantrap-Management

- Tier-I–IV-konforme Verfahren für Incident Response und Change Management

DCIM-Plattformen (zum Beispiel Schneider Electric EcoStruxure IT, Vertiv-Plattformen und andere Enterprise-Monitoring-Tools) bieten eine detaillierte Transparenz über Stromversorgung, Kühlung und Rechenkapazität. Sie unterstützen operative Exzellenz und die Berichterstattung nach EU-Artikel 12 für Rechenzentren erheblich, die Verordnung schreibt jedoch kein bestimmtes DCIM-Produkt oder keine bestimmte Plattform vor.

Mehr erfahren: Top 10 Rechenzentrums-Design-Zertifizierungen, um Ihre Karriere 2025 voranzubringen

Kernkomponenten eines Rechenzentrums: Technischer Deep Dive

Rechenressourcen

Server bleiben die zentrale Rechenressource. Im Jahr 2025 umfassen Serverbereitstellungen in Rechenzentren drei Architekturklassen:

- Allzweck-Rackserver: 1U–2U-Rack-Systeme für Web-, Anwendungs- und Datenbank-Workloads (z. B. Dell PowerEdge, HPE ProLiant, Lenovo ThinkSystem)

- GPU-beschleunigte Rechenknoten: Hochdichte Knoten mit NVIDIA H100/H200 oder AMD MI300X GPUs für KI-Training und Inferenz. Rackdichten von 40–100 kW erfordern Flüssigkeitskühlung.

- Hyperkonvergente Infrastruktur (HCI): Konvergierte Rechen-, Speicher- und Netzwerkressourcen in modularen Knoten (z. B. Nutanix, VMware vSAN) für softwaredefinierte Rechenzentrumsbereitstellungen.

Speichersysteme

In Rechenzentren eingesetzte Speichertechnologien:

|

Typ

|

Technologie

|

Typischer Anwendungsfall

|

|

All-Flash-Array (AFA)

|

NVMe-SSDs (PCIe Gen 4/5)

|

Datenbanken, KI/ML, latenzkritische Anwendungen

|

|

Storage Area Network (SAN)

|

FC- oder iSCSI-Blockspeicher

|

Enterprise-Datenbanken, Virtualisierung

|

|

Network Attached Storage (NAS)

|

NFS/SMB-Dateispeicher

|

Medien, Backup, Zusammenarbeit

|

|

Objektspeicher

|

S3-kompatibel (On-Prem/Cloud)

|

Big Data, Backups, unstrukturierte Daten

|

Kühlsysteme

Kühlung ist in der Regel nach der IT-Ausrüstung der zweitgrößte Energieverbraucher in einem Rechenzentrum. Die passende Kühlstrategie hängt von der Rackdichte und den PUE-Zielen ab:

|

Kühlmethode

|

Rackdichtebereich

|

PUE-Auswirkung

|

Geeignet für

|

|

CRAC/CRAH + Hot/Cold Aisle

|

<10 kW/Rack

|

1.4–2.0

|

Bestand / Standarddichte

|

|

In-Row-Kühlung

|

10–30 kW/rack

|

1.2–1.5

|

Enterprise-Anlagen mittlerer Dichte

|

|

Rear-Door-Wärmetauscher

|

10–40 kW/rack

|

1.2–1.4

|

Nachrüstung für hohe Dichte

|

|

Direct Liquid Cooling (DLC)

|

30–100 kW/rack

|

1.1–1.3

|

KI-/GPU-Cluster

|

|

Einphasige Immersionskühlung

|

50–200+ kW/rack

|

1.02–1.1

|

Hyperscale-KI-Compute

|

Freie Kühlung (Economizer-Modus) — die Nutzung von Außenluft oder Kühlwasser aus Kühltürmen, wenn die Umgebungstemperaturen dies erlauben — ist heute Standard bei neuen europäischen Rechenzentrumsplanungen. In nordeuropäischen Klimazonen (Schweden, Finnland, Niederlande) steht freie Kühlung für 80–95 % der jährlichen Betriebsstunden zur Verfügung und reduziert den Energiebedarf für mechanische Kühlung erheblich. Der EU Data Centre Code of Conduct empfiehlt den Einsatz freier Kühlung ausdrücklich.

Brandlöschsysteme

Brandlöschung in Rechenzentren nutzt gasförmige Clean-Agent-Systeme, die Brände löschen, ohne wasserbedingte Schäden an empfindlicher Elektronik zu verursachen:

|

Löschmittel

|

Norm

|

GWP (100 Jahre)

|

EU-F-Gas-Status

|

|

FM-200 (HFC-227ea)

|

NFPA 2001 / ISO 14520

|

3,220

|

Beschränkt; Ausstieg gemäß EU-Verordnung 2024/573

|

|

FK-5-1-12 Clean-Agent-Flüssigkeit*

|

NFPA 2001 / ISO 14520

|

1

|

Zulässig; Chemie, Produktverfügbarkeit und lokale Zulassungen fallweise spezifizieren

|

|

IG-541 (Inergen)

|

NFPA 2001 / ISO 14520

|

0

|

Zulässig; Inertgasgemisch

|

|

CO₂

|

NFPA 12

|

1

|

Für bestimmte Anwendungen zulässig

|

Hinweis für europäische Anlagen: FM-200 (HFC-227ea) hat ein Global Warming Potential von 3.220 und unterliegt schrittweisen Beschränkungen gemäß EU-F-Gas-Verordnung 2024/573. Für neue Projekte sollten die Löschmittelchemie und die geltenden Zulassungen spezifiziert werden, statt sich allein auf den früheren Markennamen „Novec 1230“ zu verlassen, da 3M die PFAS-Produktion Ende 2025 eingestellt hat. Inertgassysteme und derzeit verfügbare FK-5-1-12-Alternativen sollten während der Planung auf lokale Verfügbarkeit geprüft werden.

Mehr erfahren: Alles, was Sie über Rechenzentrumskomponenten noch nicht wussten

Uptime Institute Tier-Klassifizierung: Was sie für Ihr Rechenzentrum bedeutet

Der Uptime Institute Tier Standard ist der weltweit anerkannte Rahmen zur Klassifizierung der Zuverlässigkeit von Rechenzentren. Das Verständnis der Tier-Anforderungen ist für Planungs- und Beschaffungsentscheidungen wesentlich:

|

Tier

|

Verfügbarkeit

|

Jährliche Ausfallzeit

|

Redundanz

|

Typischer Anwendungsfall

|

|

Tier I

|

99,671 %

|

28,8 Std./Jahr

|

N — keine Redundanz

|

Kleinunternehmen / Einzelstandort

|

|

Tier II

|

99,741 %

|

22,7 Std./Jahr

|

N+1 (teilweise)

|

Allgemeines Enterprise-Umfeld

|

|

Tier III

|

99,982 %

|

1,6 Std./Jahr

|

N+1 gleichzeitig wartbar

|

Enterprise / Colocation

|

|

Tier IV

|

99,995 %

|

26,3 Min./Jahr

|

2N+1 fehlertolerant

|

Missionskritisch / Finanzsektor / DC

|

Tier III ist die am häufigsten angestrebte Klassifizierung für Unternehmens- und Colocation-Rechenzentren. Tier IV ist für missionskritische nationale Infrastruktur, Finanzhandelssysteme und groß angelegte staatliche Einrichtungen vorgesehen. In Europa wird die Planung von Rechenzentren häufig an der Normenreihe EN 50600 / ISO/IEC 22237 ausgerichtet, die Verfügbarkeitsklassen statt der Tier-Terminologie des Uptime Institute verwendet.

Optimierung des Rechenzentrumslayouts: Best Practices für 2026

- Hot-/Cold-Aisle-Containment: Die kosteneffizienteste Optimierung der Kühlung. Die Trennung heißer Abluft (von der Serverrückseite) von kalter Zuluft (zur Servervorderseite) reduziert den Kühlenergiebedarf im Vergleich zu offenen Flurlayouts um 20–30 %. Cold Aisle Containment (CAC) und Hot Aisle Containment (HAC) mit Decken- oder Kaminrückführung sind weit verbreitet.

- Modulares Pod-Design: Eine schrittweise Erweiterung in eigenständigen 1–5-MW-Pods ermöglicht bedarfsgerechte Skalierung und vermeidet Überinvestitionen in Infrastrukturkapazitäten vor dem tatsächlichen IT-Lastwachstum.

- Kabelmanagement über Kopf: Überkopf-Kabeltrassen (Signalkabel oberhalb von Stromkabeln, mit mindestens 300 mm Abstand) reduzieren die Überlastung von Doppelböden, verbessern den Luftstrom und vereinfachen spätere Erweiterungen.

- Strukturierte Verkabelung nach ANSI/TIA-942: Der ANSI/TIA-942-Standard (Telecommunications Infrastructure Standard for Data Centers) definiert Verkabelungstopologie, Trassenführung und Raumanforderungen für Rechenzentren und nutzt ein eigenes Rated-1- bis Rated-4-Klassifizierungssystem.

- Physische Sicherheitsebenen: Mehrschichtige Zutrittskontrolle — Perimeterschutz, Fahrzeugbarrieren, Mantrap/Luftschleuse, biometrische Leser an jeder Zonengrenze und CCTV mit Analytik — ist Standard für Tier-III-Anlagen und höher.

Nachhaltigkeits-Compliance: Europäische Rechenzentren mit einer installierten IT-Leistungsnachfrage von mindestens 500 kW unterliegen den Berichtspflichten nach Artikel 12 der EU-Energieeffizienzrichtlinie (EED). Die Delegierte Verordnung (EU) 2024/1364 der Kommission legt die erste Phase des gemeinsamen Berichts- und Bewertungssystems der Union fest. Der EU Data Centre Code of Conduct v14 bleibt ein nützlicher freiwilliger Best-Practice-Rahmen.

Bereit, Ihr Rechenzentrum zukunftssicher zu machen?

Arbeiten Sie mit gbc engineers zusammen, um eine Anlage zu planen, die Leistung, Zuverlässigkeit und langfristigen Wert bietet.

🌐 Website: www.gbc-engineers.com

🏗️ Unsere Leistungen entdecken: Services — gbc engineers

Fazit

Ein gut geplantes Rechenzentrumslayout — das Serverraum, Stromversorgungsraum und NOC als voneinander abhängige Funktionszonen integriert — ist die Grundlage für eine resiliente, effiziente und zukunftsfähige digitale Infrastruktur. Im Jahr 2026 bleiben KI-bedingte Steigerungen der Rackdichte, modulare Skalierbarkeit, besseres Monitoring und strengere Nachhaltigkeitsberichte die wichtigsten Planungstrends — insbesondere in der EU.

Bei gbc engineers unterstützen wir Eigentümer, Betreiber und Investoren von Rechenzentren in Europa und Südostasien mit fachkundigen Leistungen im Tragwerks- und Ingenieurbau — von der frühen Machbarkeitsstudie über die Ausführungsplanung bis zur Bauunterstützung.

Häufig gestellte Fragen

Was sind die drei Hauptzonen in einem Rechenzentrumslayout?

Die drei Hauptzonen sind: (1) der Serverraum, in dem IT-Geräte wie Server, Speicher und Netzwerktechnik untergebracht sind; (2) der Stromversorgungsraum mit USV-Systemen, Generatoren, Schaltanlagen und PDUs; und (3) das Network Operations Center (NOC), das die 24/7-Überwachung und Steuerung aller Anlagensysteme übernimmt.

Was ist PUE in einem Rechenzentrum?

PUE (Power Usage Effectiveness) ist die wichtigste Energieeffizienzkennzahl für Rechenzentren und wird als Gesamtenergieverbrauch der Anlage geteilt durch den Energieverbrauch der IT-Geräte berechnet. Ein PUE von 1,0 wäre theoretisch perfekt, da die gesamte Energie für IT genutzt würde. Hyperscale-Anlagen erreichen PUE-Werte von 1,08–1,12; der globale Durchschnitt für Colocation-Anlagen liegt bei etwa 1,45–1,58 (Uptime Institute, 2024).

Welche Tier-Zertifizierung benötigt ein Rechenzentrum?

Die erforderliche Tier-Stufe hängt von der Anwendung ab. Tier III (99,982 % Verfügbarkeit) ist das häufigste Ziel für Unternehmens- und Colocation-Anlagen und bietet N+1-Redundanz sowie gleichzeitige Wartbarkeit. Tier IV (99,995 %) wird typischerweise für die missionskritischsten Umgebungen in Betracht gezogen, doch die passende Tier-Stufe hängt vom Business Case, der Risikotoleranz und den betrieblichen Anforderungen ab.

Welche Kühlsysteme werden in modernen Rechenzentren eingesetzt?

Moderne Rechenzentren nutzen je nach Rackdichte unterschiedliche Kühlsysteme: CRAC/CRAH-Einheiten mit Hot-/Cold-Aisle-Containment für Standarddichten (<10 kW/Rack); In-Row-Kühlung und Rear-Door-Wärmetauscher für mittlere Dichten (10–40 kW/Rack); sowie Direct Liquid Cooling (DLC) oder Immersionskühlung für hochdichte KI-/GPU-Workloads (40–200+ kW/Rack).

|

Über uns

gbc engineers

ist ein international tätiges Ingenieurbüro mit Standorten in Deutschland, Polen und Vietnam und hat weltweit bereits über 10.000 Projekte realisiert. Wir bieten Leistungen in den Bereichen Tragwerksplanung, Rechenzentrumsplanung, Infrastruktur- und Brückenbau, BIM & Scan-to-BIM sowie Projekt- und Baumanagement an. Durch die Verbindung deutscher Ingenieurqualität mit internationaler Expertise schaffen wir für unsere Auftraggeber nachhaltige, sichere und effiziente Lösungen.

|