Dobrze zaprojektowany układ centrum danych jest podstawą stabilnej, ciągłej pracy infrastruktury IT. Niezależnie od tego, czy jesteś na wczesnym etapie projektowania, czy zarządzasz istniejącym obiektem operacyjnym, każde centrum danych definiują dwa pytania:

- Jakie są kluczowe komponenty centrum danych?

- Jakiej infrastruktury fizycznej wymaga obiekt centrum danych?

W tym przewodniku gbc engineers wyjaśnia, jak zorganizowany jest typowy układ centrum danych, jaki wkład każda strefa wnosi w ogólną wydajność i niezawodność oraz jakie priorytety projektowe na 2026 rok zmieniają obiekty na całym świecie.

Czym jest układ centrum danych?

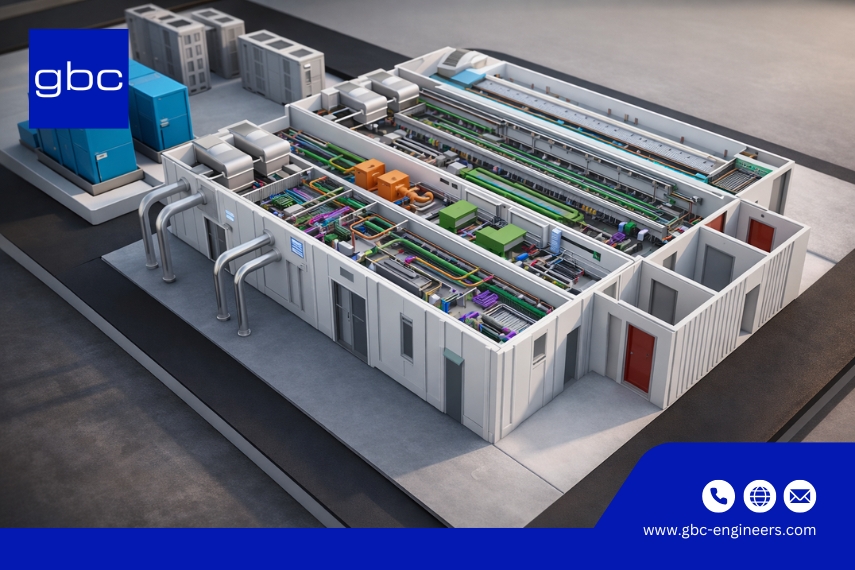

Układ centrum danych to zaplanowana fizyczna organizacja infrastruktury IT, systemów zasilania, urządzeń chłodniczych i zabezpieczeń w obiekcie centrum danych. Dobrze zaprojektowany układ zapewnia niezawodność pracy 24/7, efektywność energetyczną, bezpieczeństwo fizyczne oraz skalowalność pod przyszły rozwój.

Trzy kluczowe strefy układu centrum danych

Standardowy układ centrum danych jest podzielony na trzy główne strefy funkcjonalne, z których każda pełni odrębną i krytyczną rolę:

|

Strefa

|

Główna funkcja

|

Kluczowe wyposażenie

|

|

Pomieszczenie serwerowe

|

Przetwarzanie IT, pamięć masowa, sieć

|

Serwery, przełączniki, routery, zapory, macierze pamięci

|

|

Pomieszczenie zasilania

|

Zasilanie, kondycjonowanie, backup

|

UPS, generatory, PDUs, rozdzielnice, transformatory

|

|

Network Operations Center (NOC)

|

Monitoring 24/7, zarządzanie, reagowanie na incydenty

|

Ściany wideo, DCIM, systemy alarmowe, kontrola zdalnego dostępu

|

1. Pomieszczenie serwerowe (computer room)

Pomieszczenie serwerowe jest operacyjnym sercem centrum danych i mieści cały krytyczny sprzęt IT. Jest to klimatyzowana przestrzeń z ograniczonym dostępem, zaprojektowana tak, aby maksymalizować gęstość obliczeniową przy jednoczesnym utrzymaniu optymalnych warunków pracy.

Standardowe wyposażenie pomieszczenia serwerowego obejmuje:

- Serwery: węzły obliczeniowe rackowe, blade lub modułowe do przetwarzania i lokalnego przechowywania danych

- Przełączniki Top-of-Rack (ToR) i routery rdzeniowe: zapewniające wewnętrzną łączność sieciową east-west oraz zewnętrzną łączność north-south

- Zapory sieciowe i load balancery: do ochrony perymetrycznej, zarządzania ruchem i dostarczania aplikacji

- Systemy pamięci masowej: SAN, macierze NAS oraz całkowicie flashowe pamięci NVMe do wysokowydajnego zarządzania danymi

- Kontrolery dostarczania aplikacji (ADCs): optymalizujące wydajność i dostępność aplikacji

Nowoczesne pomieszczenia serwerowe coraz częściej pracują przy wysokich gęstościach (10–30+ kW/rack dla standardowych obciążeń; 40–100+ kW/rack dla klastrów AI/GPU), co napędza stosowanie bezpośredniego chłodzenia cieczą (DLC) i chłodzenia immersyjnego na poziomie racka obok tradycyjnego chłodzenia powietrznego.

ASHRAE TC 9.9 definiuje zalecane zakresy pracy dla sprzętu IT. Urządzenia klasy A2 — najczęstsza klasyfikacja serwerów korporacyjnych — są dopuszczone do pracy przy temperaturze powietrza wlotowego 10–35°C (50–95°F), z zakresem dopuszczalnym 5–40°C (41–104°F). Większość obiektów dąży do temperatury powietrza nawiewanego 18–27°C (64–80°F), aby utrzymać bezpieczne marginesy operacyjne.

2. Pomieszczenie zasilania

Pomieszczenie zasilania zarządza wszystkimi aspektami dostarczania energii do centrum danych — od przyłącza energetycznego po pojedynczy rack. Jego projekt bezpośrednio determinuje niezawodność, efektywność i klasyfikację Tier obiektu.

Kluczowe komponenty pomieszczenia zasilania:

- Zasilacz bezprzerwowy (UPS): zapewnia płynne zasilanie pomostowe podczas przerw w dostawie energii, zanim uruchomią się generatory. Topologia podwójnej konwersji (online) zgodnie z IEC 62040-3 klasa VFI jest standardem dla obiektów Tier III i Tier IV.

- Generatory awaryjne: generatory dieslowskie lub gazowe dobrane do pełnego obciążenia obiektu, zazwyczaj z zapasem paliwa na miejscu na 12–48 godzin. Automatyczne przełączniki zasilania (ATS) zapewniają przełączenie w ciągu 10–30 sekund.

- Rozdzielnice średniego napięcia i transformatory: dla obiektów powyżej około 1 MW rozdzielnice SN (10–22 kV w Europie; 12–25 kV w Ameryce Północnej) obniżają napięcie sieciowe za pomocą transformatorów suchych.

- Jednostki dystrybucji zasilania (PDUs): zespoły dystrybucyjne na poziomie podłogi, które obniżają i rozprowadzają zasilanie do racków IT, z monitoringiem obwodów odpływowych.

- Rack PDUs (rPDUs): montowane w rackach IT do końcowego dostarczania zasilania, z pomiarem oraz, w wariantach zarządzalnych, możliwością zdalnego przełączania.

Nowoczesne obiekty stosują podwójną architekturę zasilania A+B, dostarczając każdemu krytycznemu obciążeniu IT energię z dwóch w pełni niezależnych ścieżek zasilania. Eliminuje to pojedynczy punkt awarii w łańcuchu dystrybucji energii.

Power Usage Effectiveness (PUE) — stosunek całkowitej mocy obiektu do mocy sprzętu IT — jest podstawową miarą efektywności energetycznej. Cele według typu obiektu:

|

Typ obiektu

|

Docelowe PUE (2026)

|

Źródło / benchmark

|

|

Hyperscale (Google, Meta)

|

1,08–1,12

|

Google Environmental Report 2024; Meta Sustainability Report 2024

|

|

Enterprise Tier III

|

1,3–1,5

|

Uptime Institute Global DC Survey 2024

|

|

Zgodne z EU Code of Conduct

|

≤1,3 (nowe) / ≤1,5 (istniejące)

|

EU DC Code of Conduct v14 (2024)

|

|

Średnia dla kolokacji

|

1,45–1,58

|

Uptime Institute Global DC Survey 2024

|

3. Network Operations Center (NOC)

Network Operations Center jest centralnym centrum dowodzenia służącym do monitorowania i zarządzania całą infrastrukturą IT oraz infrastrukturą fizyczną centrum danych. W nowoczesnych obiektach NOC integruje monitoring IT, bezpieczeństwo fizyczne, kontrolę środowiskową i zarządzanie energią w jeden spójny obraz operacyjny.

Typowe funkcje NOC obejmują:

- Ściany wideo pokazujące w czasie rzeczywistym topologię sieci, stan serwerów i pulpity środowiskowe

- Oprogramowanie Data Center Infrastructure Management (DCIM) — jeden centralny widok do planowania pojemności, zarządzania zasobami i optymalizacji energii

- Integrację Security Information and Event Management (SIEM) do monitorowania cyberbezpieczeństwa

- Systemy bezpieczeństwa fizycznego: CCTV, kontrola dostępu (biometria + czytnik kart), zarządzanie śluzami bezpieczeństwa

- Procedury reagowania na incydenty i zarządzania zmianą zgodne z Tier I–IV

Platformy DCIM (na przykład Schneider Electric EcoStruxure IT, platformy Vertiv oraz inne narzędzia monitoringu klasy enterprise) zapewniają szczegółową widoczność zasilania, chłodzenia i mocy obliczeniowej. Silnie wspierają doskonałość operacyjną oraz raportowanie centrów danych zgodnie z art. 12 UE, ale regulacja nie narzuca konkretnego produktu ani platformy DCIM.

Czytaj więcej: 10 najlepszych certyfikatów z projektowania centrów danych, które pomogą Ci rozwinąć karierę w 2025 roku

Kluczowe komponenty centrum danych: techniczne omówienie

Zasoby obliczeniowe

Serwery pozostają podstawowym zasobem obliczeniowym. W 2025 roku wdrożenia serwerów w centrach danych obejmują trzy kategorie architektoniczne:

- Uniwersalne serwery rackowe: systemy rackowe 1U–2U do obciążeń webowych, aplikacyjnych i bazodanowych (np. Dell PowerEdge, HPE ProLiant, Lenovo ThinkSystem)

- Węzły obliczeniowe akcelerowane GPU: węzły o wysokiej gęstości wyposażone w GPU NVIDIA H100/H200 lub AMD MI300X do trenowania i inferencji AI. Gęstości racków 40–100 kW wymagają chłodzenia cieczą.

- Infrastruktura hiperkonwergentna (HCI): połączone zasoby obliczeniowe, pamięci masowej i sieciowe w modułowych węzłach (np. Nutanix, VMware vSAN) dla wdrożeń centrów danych definiowanych programowo.

Systemy pamięci masowej

Technologie pamięci masowej stosowane w centrach danych:

|

Typ

|

Technologia

|

Typowe zastosowanie

|

|

Macierz all-flash (AFA)

|

Dyski NVMe SSD (PCIe Gen 4/5)

|

Bazy danych, AI/ML, aplikacje wrażliwe na opóźnienia

|

|

Storage Area Network (SAN)

|

Pamięć blokowa FC lub iSCSI

|

Bazy danych enterprise, wirtualizacja

|

|

Network Attached Storage (NAS)

|

Pamięć plikowa NFS/SMB

|

Media, backup, współpraca

|

|

Pamięć obiektowa

|

Zgodna z S3 (on-prem/cloud)

|

Big data, backupy, dane nieustrukturyzowane

|

Systemy chłodzenia

Chłodzenie jest zazwyczaj drugim największym odbiorcą energii w centrum danych po sprzęcie IT. Właściwa strategia chłodzenia zależy od gęstości racków i celów PUE:

|

Metoda chłodzenia

|

Zakres gęstości racków

|

Wpływ na PUE

|

Najlepsze dla

|

|

CRAC/CRAH + hot/cold aisle

|

<10 kW/rack

|

1,4–2,0

|

Obiekty legacy / standardowa gęstość

|

|

Chłodzenie in-row

|

10–30 kW/rack

|

1,2–1,5

|

Enterprise o średniej gęstości

|

|

Tylne wymienniki ciepła

|

10–40 kW/rack

|

1,2–1,4

|

Modernizacja dla wysokiej gęstości

|

|

Direct Liquid Cooling (DLC)

|

30–100 kW/rack

|

1,1–1,3

|

Klastry AI/GPU

|

|

Immersja jednofazowa

|

50–200+ kW/rack

|

1,02–1,1

|

Hyperscale AI compute

|

Free cooling (tryb economizer) — wykorzystanie powietrza zewnętrznego lub wody z wieży chłodniczej, gdy pozwalają na to temperatury otoczenia — jest obecnie standardem w nowych projektach europejskich centrów danych. W klimacie północnoeuropejskim (Szwecja, Finlandia, Holandia) free cooling jest dostępny przez 80–95% rocznych godzin pracy, znacząco ograniczając energię zużywaną na chłodzenie mechaniczne. EU Data Centre Code of Conduct zdecydowanie zachęca do stosowania free cooling.

Systemy gaszenia pożaru

Gaszenie pożarów w centrach danych wykorzystuje systemy gazowe typu clean agent, które tłumią pożar bez szkód wodnych dla wrażliwej elektroniki:

|

Środek

|

Standard

|

GWP (100 lat)

|

Status EU F-Gas

|

|

FM-200 (HFC-227ea)

|

NFPA 2001 / ISO 14520

|

3 220

|

Ograniczony; wycofywanie na podstawie rozporządzenia UE 2024/573

|

|

Płyn clean-agent FK-5-1-12*

|

NFPA 2001 / ISO 14520

|

1

|

Dozwolony; chemię, dostępność produktu i lokalne dopuszczenia określać indywidualnie

|

|

IG-541 (Inergen)

|

NFPA 2001 / ISO 14520

|

0

|

Dozwolony; mieszanina gazów obojętnych

|

|

CO₂

|

NFPA 12

|

1

|

Dozwolony dla określonych zastosowań

|

Uwaga dla obiektów europejskich: FM-200 (HFC-227ea) ma Global Warming Potential wynoszący 3 220 i podlega stopniowym ograniczeniom zgodnie z rozporządzeniem UE F-Gas 2024/573. W nowych projektach należy określić chemię środka gaśniczego i właściwe dopuszczenia, zamiast polegać wyłącznie na dawnej nazwie marki „Novec 1230”, ponieważ 3M zakończyło produkcję PFAS pod koniec 2025 roku. Systemy gazów obojętnych oraz obecnie dostępne alternatywy FK-5-1-12 powinny być sprawdzane pod kątem lokalnej dostępności na etapie projektowania.

Czytaj więcej: Wszystko, czego nie wiedziałeś o komponentach centrum danych

Klasyfikacja Tier Uptime Institute: co oznacza dla Twojego centrum danych

Uptime Institute Tier Standard jest globalnie uznanym frameworkiem klasyfikacji niezawodności centrów danych. Zrozumienie wymagań Tier jest kluczowe zarówno dla projektowania, jak i decyzji zakupowych:

|

Tier

|

Dostępność

|

Roczny czas przestoju

|

Redundancja

|

Typowe zastosowanie

|

|

Tier I

|

99,671%

|

28,8 godz./rok

|

N — brak redundancji

|

Mała firma / pojedyncza lokalizacja

|

|

Tier II

|

99,741%

|

22,7 godz./rok

|

N+1 (częściowa)

|

Typowe środowisko enterprise

|

|

Tier III

|

99,982%

|

1,6 godz./rok

|

N+1 z możliwością równoczesnej konserwacji

|

Enterprise / kolokacja

|

|

Tier IV

|

99,995%

|

26,3 min/rok

|

2N+1 odporne na awarie

|

Krytyczne / finansowe / DC

|

Tier III jest najczęściej wybieraną klasyfikacją dla korporacyjnych i kolokacyjnych centrów danych. Tier IV jest zarezerwowany dla krytycznej infrastruktury krajowej, systemów handlu finansowego i dużych obiektów rządowych. W Europie projektowanie centrów danych jest często odnoszone do serii EN 50600 / ISO/IEC 22237, która wykorzystuje klasy dostępności zamiast terminologii Tier stosowanej przez Uptime Institute.

Optymalizacja układu centrum danych: najlepsze praktyki na 2026 rok

- Hot/cold aisle containment: najbardziej opłacalna optymalizacja chłodzenia. Oddzielenie gorącego powietrza wylotowego (z tyłu serwerów) od zimnego powietrza nawiewanego (do frontu serwerów) zmniejsza zużycie energii na chłodzenie o 20–30% w porównaniu z otwartymi układami podłogowymi. Powszechnie stosuje się zarówno cold aisle containment (CAC), jak i hot aisle containment (HAC) ze zwrotem przez sufit lub komin.

- Modułowy projekt "pod": stopniowa rozbudowa w samodzielnych modułach 1–5 MW pozwala skalować obiekt zgodnie z popytem, unikając nadmiernych inwestycji w pojemność infrastruktury przed wzrostem obciążenia IT.

- Prowadzenie kabli nad głową: górne koryta kablowe (kable sygnałowe nad zasilającymi, oddzielone co najmniej 300 mm) zmniejszają zatłoczenie podłogi podniesionej, poprawiają przepływ powietrza i ułatwiają przyszłe rozbudowy.

- Okablowanie strukturalne zgodnie z ANSI/TIA-942: standard ANSI/TIA-942 (Telecommunications Infrastructure Standard for Data Centers) definiuje topologię okablowania, trasy i wymagania przestrzenne dla centrów danych oraz stosuje własny system klasyfikacji Rated-1 do Rated-4.

- Warstwy bezpieczeństwa fizycznego: wielowarstwowa kontrola dostępu — ogrodzenie perymetryczne, bariery dla pojazdów, śluza/mantrap, czytniki biometryczne na granicach stref oraz CCTV z analityką — jest standardem dla obiektów Tier III i wyższych.

Zgodność w zakresie zrównoważonego rozwoju: europejskie centra danych z zainstalowanym zapotrzebowaniem mocy IT wynoszącym co najmniej 500 kW podlegają obowiązkom raportowania na podstawie art. 12 dyrektywy UE w sprawie efektywności energetycznej (EED). Rozporządzenie delegowane Komisji (UE) 2024/1364 określa pierwszy etap wspólnych unijnych ram raportowania i oceny. EU Data Centre Code of Conduct v14 pozostaje użytecznym dobrowolnym frameworkiem najlepszych praktyk.

Gotowi zabezpieczyć swoje centrum danych na przyszłość?

Współpracuj z gbc engineers, aby zaprojektować obiekt zapewniający wydajność, niezawodność i długoterminową wartość.

🌐 Odwiedź: www.gbc-engineers.comwww.gbc-engineers.com

🏗️ Poznaj nasze usługi: Services — gbc engineersServices — gbc engineers

Podsumowanie

Dobrze zaprojektowany układ centrum danych — integrujący pomieszczenie serwerowe, pomieszczenie zasilania i NOC jako współzależne strefy funkcjonalne — jest podstawą odpornej, efektywnej i gotowej na przyszłość infrastruktury cyfrowej. W 2026 roku najważniejszymi trendami projektowymi pozostają wzrost gęstości racków napędzany AI, modułowa skalowalność, lepszy monitoring i bardziej rygorystyczne raportowanie zrównoważonego rozwoju — szczególnie w UE.

W gbc engineers wspieramy właścicieli, operatorów i inwestorów centrów danych w Europie i Azji Południowo-Wschodniej specjalistycznymi usługami inżynierii konstrukcyjnej i lądowej — od wczesnych analiz wykonalności po projekt wykonawczy i wsparcie budowy.

Najczęściej zadawane pytania

Jakie są trzy główne strefy w układzie centrum danych?

Trzy główne strefy to: (1) pomieszczenie serwerowe, w którym znajduje się sprzęt IT, taki jak serwery, pamięć masowa i sieć; (2) pomieszczenie zasilania, zawierające systemy UPS, generatory, rozdzielnice i PDUs; oraz (3) Network Operations Center (NOC), które zapewnia całodobowe monitorowanie i zarządzanie wszystkimi systemami obiektu.

Czym jest PUE w centrum danych?

PUE (Power Usage Effectiveness) to podstawowa miara efektywności energetycznej centrów danych, obliczana jako całkowita moc obiektu podzielona przez moc sprzętu IT. PUE na poziomie 1,0 jest teoretycznie idealne, ponieważ cała energia byłaby zużywana przez IT. Obiekty hyperscale osiągają PUE 1,08–1,12; globalna średnia dla obiektów kolokacyjnych wynosi około 1,45–1,58 (Uptime Institute, 2024).

Jakiej certyfikacji Tier potrzebuje centrum danych?

Wymagany Tier zależy od zastosowania. Tier III (99,982% dostępności) jest najczęstszym celem dla obiektów korporacyjnych i kolokacyjnych, zapewniając redundancję N+1 oraz możliwość równoczesnej konserwacji. Tier IV (99,995%) jest zwykle rozważany dla najbardziej krytycznych środowisk, ale właściwy Tier zależy od uzasadnienia biznesowego, tolerancji ryzyka i wymagań operacyjnych.

Jakie systemy chłodzenia stosuje się w nowoczesnych centrach danych?

Nowoczesne centra danych stosują różne systemy chłodzenia w zależności od gęstości racków: jednostki CRAC/CRAH z hot/cold aisle containment dla standardowych gęstości (<10 kW/rack); chłodzenie in-row i tylne wymienniki ciepła dla średnich gęstości (10–40 kW/rack); oraz bezpośrednie chłodzenie cieczą (DLC) lub chłodzenie immersyjne dla wysokogęstościowych obciążeń AI/GPU (40–200+ kW/rack).

|

O nas

gbc engineers

to międzynarodowe biuro inżynierskie z oddziałami w Niemczech, Polsce i Wietnamie, które zrealizowało ponad 10 000 projektów na całym świecie. Świadczymy usługi w zakresie inżynierii konstrukcyjnej, projektowania centrów danych, inżynierii infrastruktury i mostów, BIM & Scan-to-BIM oraz zarządzania budową. Łącząc niemiecką jakość inżynieryjną z międzynarodowym doświadczeniem, dostarczamy klientom zrównoważone, bezpieczne i efektywne rozwiązania.

|